E. SÉCURISER LE RECOURS À L'IA

1. IA, données sensibles et responsabilité juridique des exécutifs locaux

Pour les élus locaux et les agents publics, le recours à l'IA n'est pas sans susciter des interrogations compréhensibles et des craintes légitimes au regard des implications en droit résultant de cette technologie. En effet, dans la mesure où l'IA se trouve à l'origine d'un nouvel écosystème avec ses acteurs et ses règles propres, elle ouvre le champ de la réflexion sur de nouvelles problématiques. En particulier, du point de vue de l'engagement de la responsabilité juridique, l'IA pose des questions inédites.

En droit interne, le régime de responsabilité exige de démontrer l'existence d'une faute, d'un préjudice et d'identifier le lien de causalité entre les deux, ou de démontrer le préjudice et le lien de causalité entre le fait générateur et le préjudice. Or, avec l'IA, c'est bien « l'identification du fait générateur du dommage et du responsable correspondant et la caractérisation du lien de causalité » qui sont rendues plus complexes, ainsi que le souligne le Conseil d'État dans son étude « Intelligence artificielle et action publique : construire la confiance, servir la performance »23(*). En quelque sorte, le régime en vigueur revient à exiger d'une victime la preuve de la faute de l'humain derrière le dommage causé par l'utilisation d'un système IA.

À cette difficulté majeure, le Conseil d'État ajoute que divers types de dysfonctionnements de l'IA peuvent complexifier encore la recherche de la responsabilité juridique :

« - un défaut de conception ou de développement imputable au fournisseur (ex : un jeu de données d'entraînement ou de validation inadapté, un mauvais choix d'algorithme, un défaut de programmation...) ;

- un défaut d'utilisation (ex : l'utilisation d'un système IA dans un environnement pour lequel il n'a pas été conçu, l'absence de ré-apprentissage pourtant prescrit par le producteur ou un ré-apprentissage vicié, la poursuite de l'utilisation du système en dépit des défaillances constatées...) ;

- l'intervention malveillante d'un tiers (ex : cyber-attaques...). »

|

IA et régime de responsabilité : des clarifications attendues Dans l'univers des collectivités territoriales, trois catégories d'acteurs peuvent voir leur responsabilité engagée dans le cadre du recours à l'IA : les collectivités en tant que personnes morales, les élus et les agents publics. La collectivité territoriale peut voir sa responsabilité engagée si, dans le cadre du recours à l'IA, la collectivité a manqué à ses obligations. Par exemple, si la collectivité utilise un système IA pour optimiser le fonctionnement de ses services d'inhumation et que ce système est victime d'une cyber-attaque. Alors l'interruption (ou l'altération) du service public funéraire peut conduire la famille connaissant ce préjudice à rechercher la responsabilité administrative de la collectivité sur le terrain de la faute (défaut de protection contre le cyber-risque). Mais la collectivité peut également voir sa responsabilité engagée pour « faute de service » commise par l'un de ses agents. En effet, lorsqu'un agent commet une faute dans l'exercice de ses fonctions pendant le service, avec les moyens du service et en-dehors de tout intérêt personnel, c'est la responsabilité de la collectivité qui est engagée. Le lien entre la faute de service et le mauvais usage de l'IA reste toutefois à explorer et à préciser, tant il n'apparaît pas immédiatement évident. De leur côté, les élus et les agents publics peuvent voir leur responsabilité engagée pour « faute personnelle » (imprudence, négligence, malveillance). La faute personnelle est soit une faute totalement détachable de l'activité du service de l'élu ou de l'agent, soit une faute non dépourvue de lien avec le service, soit une faute en lien avec le service mais qui témoigne d'une particulière et exceptionnelle gravité. Toutefois, là encore, le régime de responsabilité demande à être précisé par la jurisprudence dans les nombreux cas d'utilisation de l'IA. |

Ces zones d'ombre incitent d'autant plus à réfléchir aux précautions susceptibles d'être prises par les collectivités, leurs élus et leurs agents afin d'éviter de voir leur responsabilité engagée dans le cadre d'une utilisation de l'IA.

La Commission nationale de l'informatique et des libertés (CNIL) identifie deux niveaux de précaution : « pour le développement d'un système d'IA, il convient de combiner une analyse de sécurité " classique " portant notamment sur la sécurité de l'environnement et la sécurité du développement logiciel et de sa maintenance, avec une analyse des risques spécifiques aux systèmes d'IA ». Lors de son audition par vos rapporteures, la CNIL a d'ailleurs tenu à rappeler son rôle de conseil et d'accompagnement dans le déploiement de systèmes numériques et d'IA. Ainsi, en 2023, la Commission a traité 214 demandes de conseil en provenance de collectivités territoriales.

Au-delà de cette grille de lecture très générale, il est aussi nécessaire que rassurant de rappeler, comme l'a fait l'avocat et consultant en transformation des territoires et des organisations publiques, Nathanaël Duffit-Ménard, lors de son audition par vos rapporteures le 30 octobre 2024, que « l'IA entre dans le champ du droit public numérique ». Or, face aux risques du numérique, les acteurs locaux sont loin d'être démunis.

Une première précaution consiste à assurer la protection des données personnelles. Pour ce faire, les décideurs locaux peuvent s'appuyer sur le règlement général sur la protection des données (RGPD). Maître Nathanaël Duffit-Ménard souligne que « le RGPD a un avantage indéniable car il s'est déjà implanté, notamment en imposant aux collectivités la désignation d'un délégué à la protection des données » ou encore en exigeant l'élaboration de certains documents (registre des traitements, analyse d'impact...). L'implantation du RGPD est telle que, selon l'avocat, « aujourd'hui, c'est automatique, quand on implante un système d'IA, on met la couche RGPD ». Au surplus, le RGPD permet une appréhension des cyber-risques puisque « l'article 32 du RGPD oblige à mettre en place des garanties contre les cyber-risques ». Surtout, le RGPD a déjà permis une sensibilisation globale - sans être totale - aux enjeux que représente la protection des données. Or, dans le cadre du développement et du recours à l'IA, une « culture de la protection des données » constitue un enjeu majeur.

La seconde précaution que peuvent prendre les collectivités, leurs élus et leurs agents consiste à sécuriser plus spécifiquement l'ensemble des services ayant recours à des systèmes d'IA. En la matière, les collectivités peuvent s'appuyer sur le référentiel général de sécurité (RGS) édicté par le décret n° 2010-112 du 2 février 2010. Bien qu'il ne porte pas spécifiquement sur l'IA, ce référentiel a pour objectif de renforcer la confiance des usagers dans les téléservices mis à disposition par les collectivités. Il fixe un ensemble de règles de sécurité applicable aux collectivités, mais aussi à leurs prestataires, dans le cadre de la démarche de sécurisation de leurs systèmes d'information. En définissant des exigences de sécurité pour tous les téléservices ainsi que pour les prestataires des collectivités, ce référentiel constitue un repère approprié à « l'écosystème de l'IA ». Il met à disposition un levier dont les collectivités peuvent user pour encadrer le développement et le recours à l'IA au sein de leurs services, dans le respect des missions de service public. Dans un registre complémentaire de celui évoqué supra pour la CNIL, l'Agence nationale de la sécurité des systèmes d'information (ANSSI) peut d'ailleurs intervenir en conseil et en accompagnement des collectivités en vue de cet objectif de sécurisation.

Enfin, les collectivités et leurs décideurs peuvent s'appuyer sur les recommandations prévues par le Règlement européen sur l'IA (RIA ou AI Act).

|

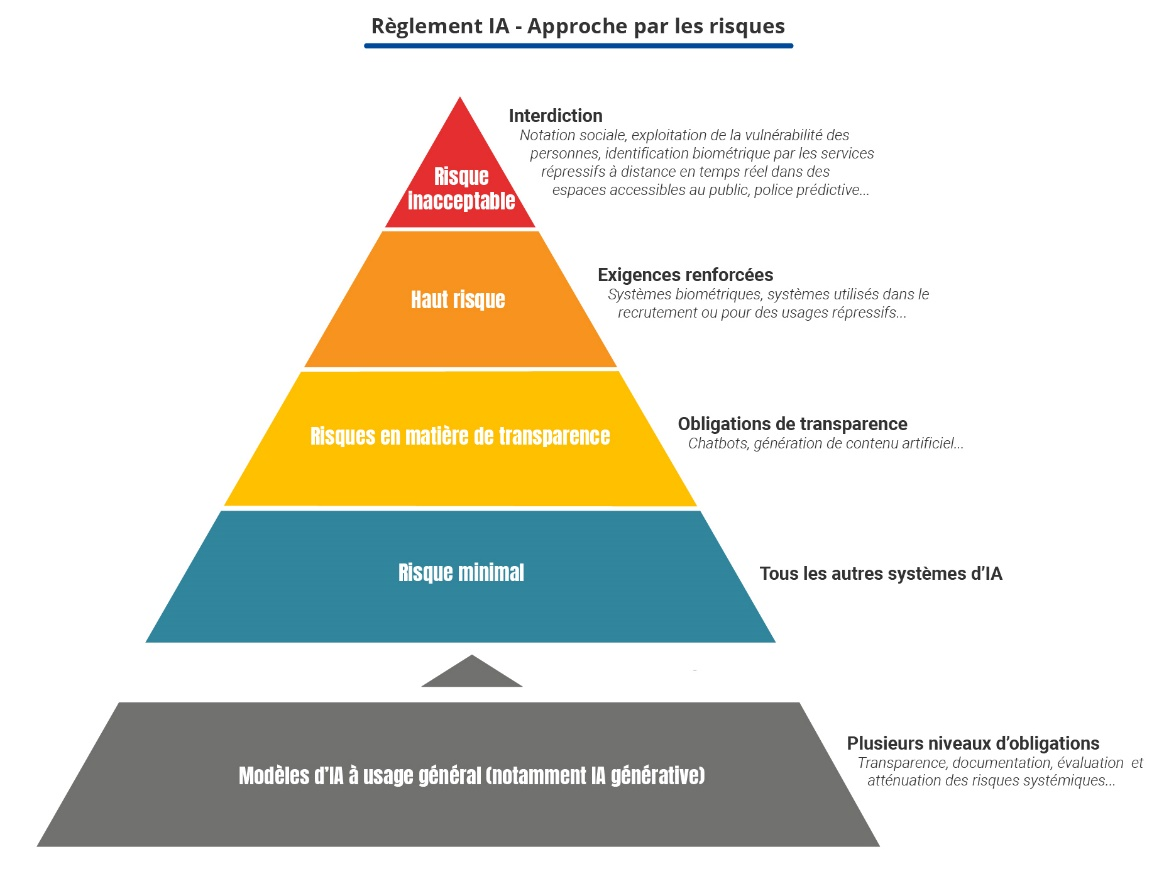

Le Règlement européen sur l'IA

(AI Act) : Adopté le 13 juin 2024, l'AI Act est entré en vigueur au 1er août 2024. Ce texte vise à établir des systèmes d'IA « sûrs, transparents, traçables, non-discriminatoires et respectueux de l'environnement ». Pour ce faire, ce règlement développe une « approche par les risques » en catégorisant les usages de l'IA selon leur niveau de risque : à chaque niveau de risque est associé un certain nombre d'obligations afin de sécuriser les systèmes IA. Source : Présentation du règlement IA (CNIL) En cohérence avec d'autres textes tels que la Charte des droits et libertés fondamentaux ou encore le RGPD, l'AI Act s'applique y compris aux collectivités. Ainsi, celles qui mettent en place un système d'IA « à haut risque » doivent-elles prévoir un « système de gestion des risques », « assurer une gouvernance des données » et renseigner les autorités afin qu'elles puissent procéder à l'évaluation de la conformité de leurs systèmes d'IA « à haut risque ». De plus, lorsqu'elles sont fournisseuses de systèmes IA, les collectivités seront tenues de mettre en place une surveillance humaine et un « système de gestion de la qualité du système ». Tout dysfonctionnement doit être notifié aux autorités compétentes (encore non désignées en France). En résumé, si le règlement sur l'IA impose certaines obligations pour assurer la sécurité des systèmes IA « à haut risque », il offre des clefs aux collectivités pour sécuriser leurs systèmes IA en déployant une gouvernance spécifique aux enjeux inhérents à l'IA. |

L'AI Act revêt une importance toute particulière en ce qu'il illustre un changement de paradigme. Pour prendre la mesure de ce basculement, il faut bien comprendre que l'IA précipite la rencontre du droit français et du droit de la conformité. Le RIA, comme avant lui le RGPD ou NIS 224(*) (cf. infra Partie E. 2. c), oblige les acteurs publics à « se mettre en conformité ». Or, ainsi que le souligne Maître Nathanaël Duffit-Ménard, « l'idée de se mettre en conformité est nouvelle en France ».

Ce changement de paradigme emporte une conséquence importante : dans cette expression toute neuve du droit, il n'y a pas de place pour l'interprétation, à la différence de la pratique habituelle en droit public français. Le droit de la conformité oblige les acteurs publics à appliquer un processus. Maître Nathanaël Duffit-Ménard insiste donc sur le fait qu'« il ne s'agira plus seulement de signer un contrat avec un sous-traitant, il faudra s'assurer que celui-ci est aussi en conformité ».

Cette approche par la conformité est d'autant plus intéressante qu'elle peut offrir une porte de sortie du dilemme juridique concernant la responsabilité administrative, civile et /ou pénale, discuté supra. Le respect de l'obligation de conformité est alors susceptible de devenir le critère pour juger de l'engagement de la responsabilité d'une collectivité, de son exécutif ou de ses agents.

L'arrivée du droit de la conformité (ou compliance) dans le droit français renforce l'enjeu décisif de la formation des élus et agents publics. Effectivement, selon Maître Nathanaël Duffit-Ménard, « il faut se former pour se conformer ». Afin de sécuriser le recours à l'IA, il convient de bâtir un véritable « parcours de la donnée » visant à s'assurer que, de bout en bout, la chaîne des acteurs prenant part au développement de l'IA se conforme aux exigences de sécurité. Pour ce faire, là encore, l'avocat rappelle que les élus peuvent s'appuyer sur le droit public numérique dont l'IA est une branche. Les modes de raisonnement et les démarches de précaution déjà en vigueur dans le cadre du numérique doivent être repris et encouragés au travers de modules de sensibilisation et de formation.

|

Proposition n° 9 : sensibiliser et former les élus locaux et les cadres administratifs des collectivités au droit de la conformité, car dans le cadre d'un projet IA « il ne s'agit plus seulement de signer un contrat avec un sous-traitant, il faut s'assurer que celui-ci est aussi en conformité ». Délai : 3 ans Acteur(s) : Associations d'élus locaux, CNFPT, CDG |

2. Une mise en oeuvre de l'IA conforme aux standards nationaux et européens de sécurité

a) Le risque de cyberattaque

Les craintes autour de l'IA ne sont pas uniquement liées à l'outil technologique en tant que tel. Elles s'étendent à son écosystème numérique, souvent associé aux cyber-risques et aux cyberattaques. La donnée représente en effet un marché de plus en plus lucratif, elle s'achète et se revend y compris lorsqu'elle a été préalablement dérobée.

Le cyber-risque encouru en cas d'utilisation de l'IA constitue un frein dans l'esprit de nombre d'élus locaux. Derrière cette inquiétude se pose la question essentielle de la sécurisation des données personnelles transmises par la population, ainsi que des données de la collectivité. Cet enjeu est d'autant plus crucial que les cyberattaques peuvent aller jusqu'à fragiliser la continuité même du service public.

Les craintes exprimées par les élus ne relèvent pas du pur fantasme, mais sont au contraire parfaitement (et malheureusement) fondées. Les collectivités territoriales n'échappent pas à l'accroissement des nouveaux risques inhérents au développement du numérique et de la technologie. Il faut même constater que ces risques s'intensifient.

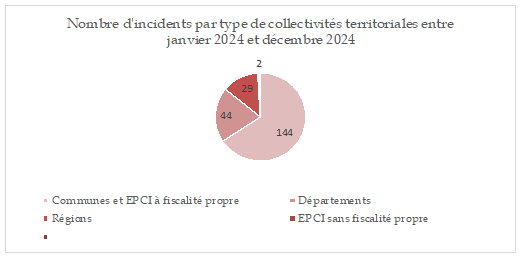

De janvier à décembre 2024, l'ANSSI déclare avoir traité « 219 incidents cyber affectant les collectivités territoriales, soit une moyenne de 18 incidents par mois et 14 % de l'ensemble des incidents traités par l'ANSSI sur la période »25(*).

La ventilation des cyber-incidents (janvier 2024 - décembre 2024)

Source : « Collectivités territoriales - synthèse de la menace » (ANSSI, février 2025)

L'ANSSI relève que « les

collectivités territoriales sont en effet des cibles de choix pour ces

acteurs [de l'écosystème criminel] »

pour deux séries de

raisons :

- d'une part, elles sont « souvent peu ou mal sécurisées, gestionnaires de systèmes d'information nombreux et disparates », « elles peuvent éprouver des difficultés à maîtriser la cartographie de leurs réseaux et à les garder dans de bonnes conditions de sécurité » ;

- d'autre part, « les données administratives, financières et personnelles des administrés détenues au sein des collectivités sont nombreuses et présentent un intérêt pour les attaquants ».

De plus, à rebours de certaines idées reçues, la « Troisième étude du baromètre de la maturité Cyber des Collectivités françaises », publiée le 25 octobre 2024 par Cybermalveillance.gouv.fr26(*), précise que les plus petites collectivités constituent tout autant des « cibles de choix » que les plus grandes collectivités.

Portant sur les communes de moins de 25 000 habitants, cette étude met en évidence qu'une collectivité de plus de 1 000 habitants sur dix déclare avoir déjà été victime d'une ou plusieurs cyberattaques entre octobre 2023 et octobre 2024.

De la perception du cyber-risque par les collectivités territoriales

à sa matérialisation

Source : « Troisième étude du baromètre de la maturité Cyber des Collectivités françaises »

Malgré l'accroissement et l'expansion des cyber-risques, la prise de conscience de ces phénomènes par les élus est encore sporadique et insuffisante, comme le soulignaient Françoise Gatel et Serge Babary, alors respectivement présidente de votre délégation et président de la délégation sénatoriale aux entreprises, dans leur rapport d'information « La cybersécurité au sein des collectivités territoriales »27(*).

Alors que toutes les collectivités sont concernées - en témoignent les chiffres précédemment mentionnés -, la cybersécurité était encore « loin d'être une préoccupation centrale des collectivités territoriales en 2018 » relevaient Françoise Gatel et Serge Babary. Les rapporteurs imputaient cette insuffisante prise de conscience des cyber-risques de la part des élus à une « faute de temps mais également de compétences et de ressources humaines qualifiées ». Ce constat reste encore, malheureusement, largement d'actualité.

Au terme de leurs travaux, les rapporteurs concluaient néanmoins à quelques avancées, majoritairement du fait des associations d'élus locaux. Ainsi, par exemple, l'AMF a édité un guide « Cybersécurité : toutes le communes et les intercommunalités sont concernées », en novembre 2020, contribuant à la nécessaire prise de conscience collective.

b) Le déploiement d'un arsenal national de cyber-protection

Si la prise de conscience progresse, le dispositif de cyber-protection se perfectionne, notamment sous l'égide de l'ANSSI.

Lors de la réunion hors-les-murs organisée par votre délégation le 15 février 2024 à Sceaux, le Chef de la division Coordination territoriale de l'ANSSI, le Général François Degez, témoignait du rôle grandissant de l'agence dans la cyber-protection des collectivités : « l'ANSSI s'est déployée progressivement dans les territoires pour un accompagnement allant au-delà de ses bénéficiaires traditionnels ».

Pour ce faire, l'ANSSI a pu bénéficier de moyens accrus : « malgré la crise sanitaire, l'ANSSI a bénéficié d'un plan de relance doté d'un budget de 176 millions d'euros, dont plus de 100 millions d'euros ont été exclusivement dédiés aux collectivités ; 715 collectivités ont ainsi pu bénéficier d'un parcours de cybersécurité comprenant tout d'abord un audit payé intégralement par l'ANSSI à hauteur de 40 000 euros, avec un état des lieux complet et un plan d'action, puis un financement des principales actions à mener à hauteur de 50 000 euros. Cela a permis aux collectivités de lancer un plan d'action et un plan d'amélioration continue en matière de cybersécurité. »

Cette augmentation des moyens financiers de l'ANSSI a été conjuguée avec une meilleure mutualisation des services déjà offerts par d'autres organismes aux collectivités, notamment les opérateurs publics de services numériques (OPSN).

L'ANSSI a également déployé de nouveaux outils dont peuvent directement se saisir les collectivités, comme l'indique le Général François Degez : « nous développons par ailleurs d'autres outils : nous avons notamment mis en place depuis deux ans " MonServiceSécurisé ", une plateforme qui permet de dérouler un processus simplifié d'homologation. Pour rappel, le règlement général de sécurité datant de 2018 impose à toute administration, dès lors qu'elle échange de manière numérique soit avec les citoyens, soit avec une autre administration, d'homologuer ses services d'échanges au regard des règles de sécurité. Nous avons par ailleurs des services automatisés, dont le service active directory service (ADS). Enfin, nous avons un outil intitulé " MonAideCyber " qui est particulièrement adapté aux petites collectivités. Il s'agit d'un soutien à la mise en place d'un mécanisme d'audit assisté avec des propositions immédiates d'information ».

Ainsi, le développement d'une prise de conscience par les élus locaux des cyber-risques est-il encouragé par des mesures nationales, via l'ANSSI ou les associations d'élus.

c) L'encadrement communautaire : la directive NIS 2

Cette prise de conscience est également accompagnée par un renforcement des outils de cyber-sécurisation à l'échelle communautaire. En vigueur depuis le 7 juin 2019, le règlement européen Cybersecurity Act (UE 2019/881) offre un cadre de certification de cybersécurité visant à harmoniser, à l'échelle européenne, les méthodes d'évaluation et les différents niveaux d'assurance de la certification. L'Agence de l'Union européenne pour la cybersécurité (ENISA) en est la cheville ouvrière et cette agence travaille en concertation avec l'ANSSI. En outre, une étape décisive a été franchie avec la directive NIS 2 adoptée par le Parlement européen et le Conseil de l'Union européenne le 14 décembre 2022.

|

La transposition de la directive NIS

2 : Le périmètre d'application des obligations liées à la lutte contre les cyber-risques La directive dite NIS 2 vise à renforcer le niveau commun de cybersécurité en s'appliquant notamment aux collectivités territoriales. Concrètement, des mesures devront être mises en place par « certaines entités qualifiées comme essentielles ou importantes, en raison des services qu'elles fournissent et de leur taille ». La directive NIS 2 n'a pas encore été transposée en droit français, mais elle a fait l'objet d'un projet de loi déposé le 15 octobre 20241. Ce projet de loi propose de retenir le seuil de 30 000 habitants pour la définition des entités « essentielles », ce seuil étant toutefois susceptible d'évoluer au cours de la procédure législative. L'article 8 du projet de loi inclut dans les

entités essentielles « les

régions, L'article 9 du projet de loi définit comme des entités importantes « les communautés de communes et leurs établissements publics administratifs dont les activités s'inscrivent dans un des secteurs d'activité hautement critiques ou critiques ». Dans son projet d'étude d'impact, l'ANSSI estimait que 1 489 collectivités territoriales devraient être concernées au titre des entités essentielles et 992 communautés de communes au titre des entités importantes. Les mesures à mettre en oeuvre Les mesures à mettre en oeuvre par les entités « essentielles » et « importantes » sont de trois ordres : le partage et la mise à jour d'informations à l'ANSSI, la gestion des cyber-risques et la mise en place de mesures adaptées, ainsi que la déclaration d'incidents. Des actions de supervision seront assurées pour vérifier le respect de ces obligations. L'article 37 du projet de loi exclut les collectivités territoriales du champ des entités pouvant être sanctionnées pour non-respect desdites obligations. Saisi pour avis, le Conseil d'État2 a estimé que cette exemption « ne peut être admise » en l'absence de dispositif d'effet équivalent pour les collectivités territoriales et leurs groupements et établissements. 1 Projet de loi n° 33 (2024-2025) relatif à la résilience des infrastructures critiques et au renforcement de la cybersécurité, , déposé au Sénat le 15 octobre 2024. 2Avis Conseil d'État, Assemblée générale, séance du 6 juin 2024, n° 408320, sur le projet de loi relatif à la résilience des infrastructures critiques et au renforcement de la cybersécurité. |

La transposition à venir de cette directive « NIS 2 » n'est pas sans poser problème aux collectivités territoriales. En effet, si cette directive permet une prise de conscience à plus large échelle des cyber-risques encourus, la mise en oeuvre des mesures de lutte contre ces risques se révèle difficile d'application pour les collectivités.

Les difficultés sont d'ordre économique, mais aussi technique. La mise en oeuvre génère un coût budgétaire et exige un certain niveau de compétences, dont les collectivités sont parfois dépourvues.

Face à ce constat, plusieurs propositions ont été formulées par divers acteurs et structures. Le 21 mai 2024, la Commission supérieure du numérique et des postes (CSNP) a publié un avis28(*) par lequel les auteurs rappellent la nécessité d'adapter les exigences formulées aux collectivités territoriales. L'avis est ainsi assorti de quatorze recommandations visant à faire émerger un dispositif efficient de cybersécurité au profit des collectivités territoriales.

En particulier, l'avis de la CSNP recommande de développer un véritable accompagnement des collectivités territoriales dans la mise en oeuvre de ces nouvelles obligations (recommandation n° 9) ou encore l'élaboration d'un échelonnement des obligations (recommandation n° 4).

Les associations d'élus vont également dans ce sens et demandent la réalisation d'une étude d'impact plus précise pour qualifier les risques, menaces et coûts des cyberattaques.

Toutefois, une question demeure à ce stade en suspens : le délai de mise en conformité dont disposent les collectivités concernées. En effet, la directive et le projet de loi de transposition ne fixent aucun délai. La CSNP et le directeur général de l'ANSSI recommandent un délai de trois ans, tandis que les associations d'élus plaident pour un délai de cinq ans.

La préoccupation des associations d'élus est certes parfaitement compréhensible de vouloir ménager les conditions de transition des collectivités. Cette transition est en effet, on l'a vu, coûteuse en temps, en argent et en effectifs mobilisés. Pour autant, l'aggravation du cyber-risque doit alerter sur le caractère urgent de la situation. La sécurisation de l'environnement numérique et IA des collectivités revêt une importance stratégique du point de vue de la continuité du service public et de la protection des données des citoyens face à la menace des hackers. Dans ces conditions, vos rapporteures penchent pour un délai de mise en oeuvre de trois ans, plutôt que cinq.

|

Proposition n° 10 : fixer à trois ans le délai de mise en conformité des collectivités territoriales concernées avec la directive NIS 2. Délai : 1 an Acteur(s) : ministère de l'Intérieur (direction générale des collectivités locales) |

3. Une utilisation éthique de l'IA

Avec l'IA, il faut prendre garde à ce qu'une fascination trop exclusive pour le progrès technologique n'occulte pas le souci éthique. En d'autres termes, le recours à l'IA doit absolument s'inscrire dans un cadre éthique. Car le risque de détournement de l'IA ne peut pas être négligé. On pense bien évidemment aux hypertrucages dits « deepfakes », ces images et vidéos truquées par le recours à l'IA et tendant à se répandre sur les réseaux sociaux. Mais les projets IA développés par les pouvoirs publics eux-mêmes, dont les collectivités territoriales, sont susceptibles de comporter des biais qui doivent faire l'objet d'une attention particulière.

|

L'IA et les algorithmes : vers une société de surveillance généralisée ? Au nom de « La Quadrature du Net » qui se définit comme une association « promouvant et défendant les libertés fondamentales dans l'environnement numérique », Bastien Le Querrec et Marne Strazielle, respectivement juriste et directrice de la communication pour l'association, ont souligné deux grandes familles de risques de détournements de l'IA : - des détournements résultant de l'opacité technique de cette technologie ; - des détournements relevant d'une volonté politique initiale de sécurisation des citoyens et des espaces publics. Concernant l'opacité des algorithmes, « La Quadrature du Net » parle, dans son rapport « Vidéosurveillance algorithmique, dangers et contre-attaque » (mai 2024), d'un « jeu d'opacités multiples ». Pour l'association, l'opacité de l'IA dépasse le seul aspect technique : elle est aussi politique, administrative et pratique. Bastien Le Querrec constate que « les collectivités territoriales sont démarchées par des sociétés mais, malgré des demandes auprès de la commission d'accès aux documents administratifs (CADA), il est très difficile de savoir ce que font les logiciels vendus ». Les collectivités acheteuses de produits IA se trouvent parfois face à de véritables « boîtes noires » développées par des « entreprises qui sont les seules à avoir la main sur les choix qui se retrouvent gravés dans le code ». Ni les collectivités, ni leurs citoyens ne savent alors exactement à quoi ils ont à faire. Selon « La Quadrature du Net », ce manque de transparence facilite le détournement de l'usage des IA. L'association considère notamment que l'organisation de grands événements (rencontres sportives internationales, grands concerts...) fournit désormais le prétexte pour développer massivement le recours à une IA sécuritaire. Dans cette critique, les expérimentations autorisées dans le cadre des Jeux Olympiques et Paralympiques de Paris, par exemple, comporteraient une dimension cachée : il s'agirait autant de protéger le citoyen que de l'accoutumer à une technologie intrusive. Enfin, d'après « La Quadrature du Net », « la vidéosurveillance est en passe d'être légalisée par des moyens détournés. Les huit cas d'usage prévus par la loi ne sont que la partie émergée de l'iceberg. D'autres usages sont rendus possibles. Les Jeux Olympiques sont une excuse pour légaliser la surveillance par l'IA ». |

Les collectivités territoriales doivent tenir compte de ces dangers. C'est pourquoi le recours à l'IA nécessite le déploiement d'un cadre éthique spécifique et rigoureux, qui ne se confond pas avec l'arsenal juridique dont se dotent aujourd'hui les États (comme par exemple l'IA Act), il le complète.

Parce que les collectivités sont le lieu de rencontre entre les injonctions citoyennes en vue d'un meilleur service public et les obligations légales relatives au respect de la protection des données personnelles (RGPD, RGS...), l'échelle de la collectivité territoriale apparaît comme un niveau approprié de déploiement du filet de secours à dimension éthique.

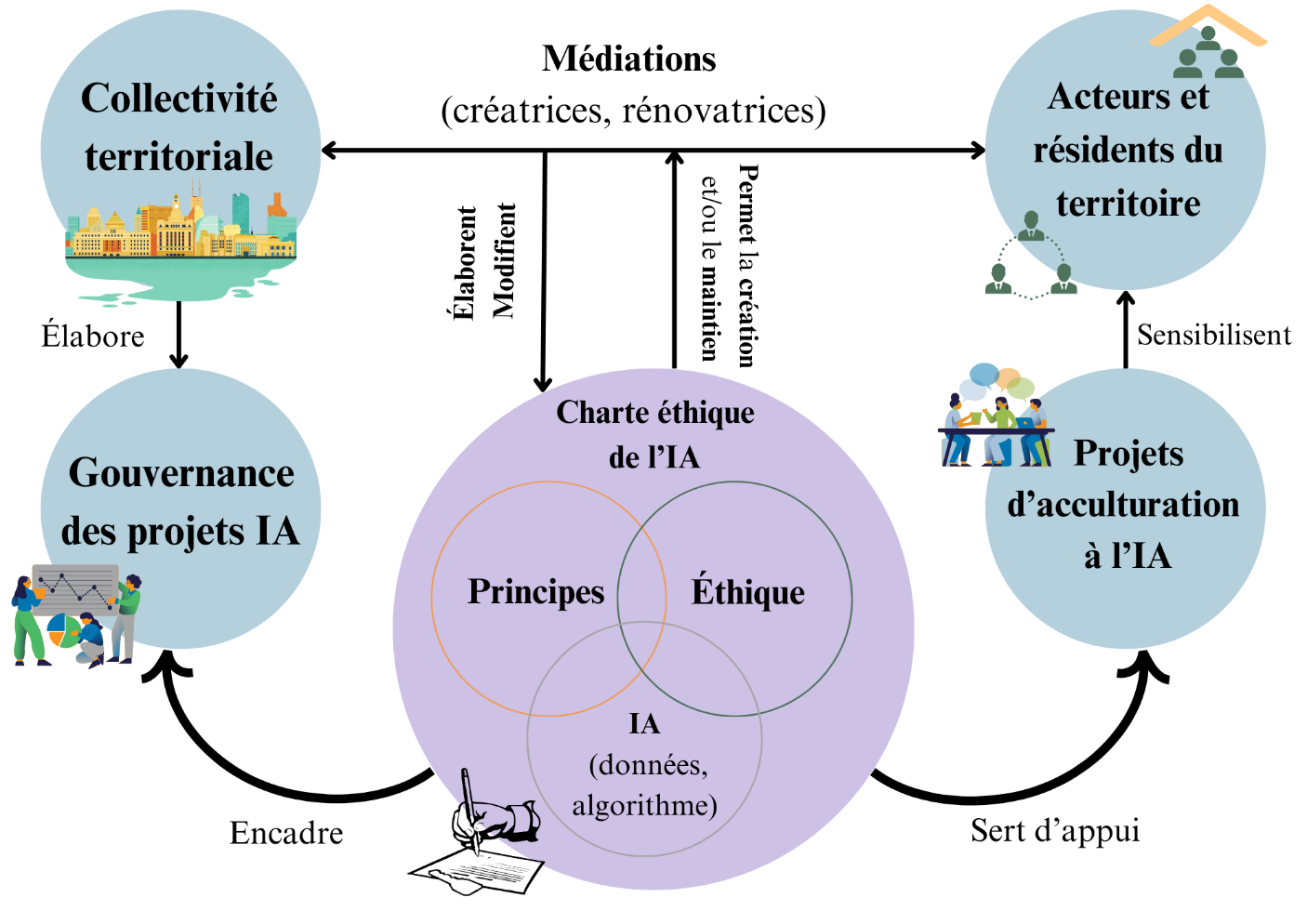

À cette maille intermédiaire peuvent être élaborés des documents relatifs au « bon usage de l'IA », sous la forme notamment de chartes éthiques. Une telle charte permet à la collectivité de fixer les principes, les valeurs et les normes éthiques auquel tout projet d'IA développé sur son territoire doit se conformer.

La réflexion sur le « bon usage de

l'IA » doit même constituer une étape obligatoire

et préalable à la construction de tout projet IA, selon le

président de l'association Ekitia et co-auteur du rapport

« Data et territoires », Bertrand Monthubert :

« l'éthique devrait être la préoccupation

première, dans un contexte de défiance grandissante envers

l'usage des données et de l'IA.

Les collectivités devraient

donc adopter une approche

« éthique by

design », c'est-à-dire en

intégrant la dimension éthique dès l'origine de chaque

projet ».

Pour le président de l'association Ekitia, la prise en compte de cette préoccupation par les collectivités peut passer par l'élaboration d'une charte éthique sur le modèle que propose son association, la « Charte Ekitia ».

3) « Qualité des données et

sécurité

du système d'information »

· Qualité des données ;

· Sécurité des données ;

· Robustesse des algorithmes.

|

4) « Transparence » · Information claire et accessible à tous ; · Explicabilité des algorithmes pour remédier à l'opacité technique ; · Auditabilité via la documentation de chaque étape pour favoriser le contrôle du projet. 5) « Gouvernance des données

· Apprentissage collectif : encourager les « communs numériques » ; · Évaluation des risques ; · Inclusion des citoyens et utilisateurs finaux ; · Intégrité : respect des règles déontologiques, esprit de coopération. 6) « Réciprocité » · Répartition équitable de la création de valeur entre les parties prenantes du projet d'IA. Aujourd'hui, « 16 collectivités territoriales ou agences liées à des collectivités sont adhérentes à la Charte d'Ekitia » : les régions Occitanie et Bretagne, Bordeaux Métropole, Montpellier Méditerranée Métropole, Toulouse Métropole, Rennes Métropole, la communauté d'agglomération du Sicoval, Haute-Garonne Numérique, Territoire d'énergie Lot, le CEREMA, l'Institut national de l'information géographique et forestière (IGN), La Poste, la SNCF, le MiPih1, le centre national d'études spatiales (CNES) et ZeFil2. 1 Structure publique de coopération hospitalière. 2 Réseaux d'infrastructures numériques pour la gestion et la commercialisation du réseau Fibre Pro de Toulouse Métropole. |

Il est important de souligner qu'une charte éthique ne constitue pas un cadre statique enserrant le recours à l'IA. Au contraire, elle peut fournir un fil conducteur dans le développement d'un projet IA de A à Z.

Le rôle et l'impact d'une charte éthique dans le développement des projets IA d'une collectivité territoriale

Source : schéma inspiré de « L'éthique des données dans les chartes éthiques des collectivités territoriales » (Ugo Verdi, 2023)

|

Proposition n° 11 : établir une charte éthique de l'IA dans les collectivités territoriales (sur la base du volontariat) pour fournir un cadre de confiance au développement de leurs projets IA. Délai : 5 ans Acteur(s) : collectivités territoriales |

* 23 Étude à la demande du Premier ministre, adoptée le 31 mars 2022 (p. 149).

* 24 Directive (UE) 2022/2555 du Parlement européen et du Conseil du 14 décembre 2022 concernant des mesures destinées à assurer un niveau élevé commun de cybersécurité dans l'ensemble de l'Union, modifiant le règlement (UE) n° 910/2014 et la directive (UE) 2018/192, et abrogeant la directive (UE) 2016/1148 (directive SRI 2), dite NIS 2.

* 25 « Collectivités territoriales - synthèse de la menace » (ANSSI, février 2025).

* 26 Groupement d'intérêt public Action contre la Cybermalveillance (GIP ACYMA), issu de la stratégie numérique du Gouvernement présenté le 18 juin 2015.

* 27 Sénat, rapport d'information n° 283 (2021-2022), déposé le 9 décembre 2021.

* 28 Avis n° 2024-03 du 21 mai 2024 sur le projet de loi relatif à la résilience des activités d'importance vitale, à la protection des infrastructures critiques, à la cybersécurité et à la résilience opérationnelle numérique du secteur financier (CSNP, 21 mai 2024).